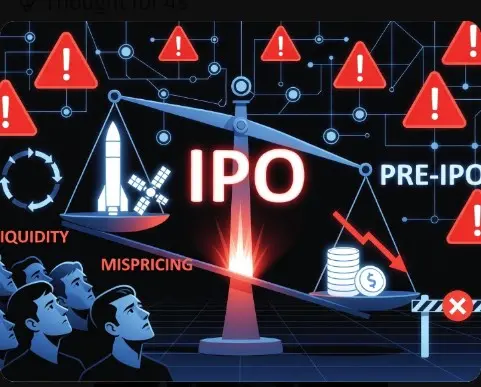

Chỉ trong 30 phút kể từ khi ra mắt, số tiền đặt mua của SpaceX (SPCX) Pre-IPOs đã vượt mốc 100 triệu USD!

Thời gian trôi qua nhanh, hãy tham gia nhanh để tối đa hóa quyền phân bổ của bạn

🔹 33.900 cổ phiếu $SPCX đang chờ đặt mua, giá đặt mua là $590

🔹 Càng đặt mua sớm, quyền phân bổ càng cao

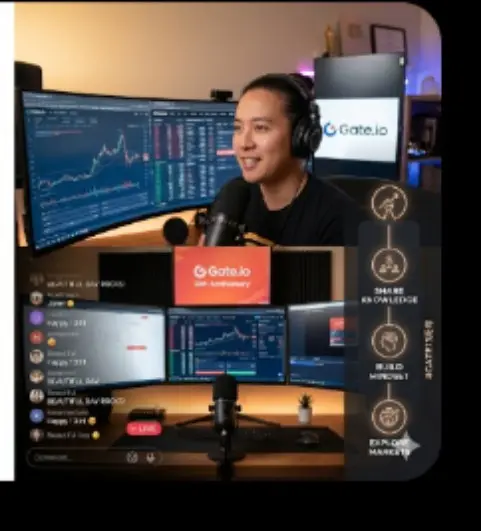

🎁 Người dùng mới tham gia đặt mua vào Quỹ Tiền Tệ, tối đa hưởng lợi nhuận hàng năm lên đến 200%

🎁 Người dùng VIP 5+ và đại lý siêu cấp đang nhận thêm phần thưởng phân phát liên tục, tham gia ngay: https://www.gate.com/ipos/2

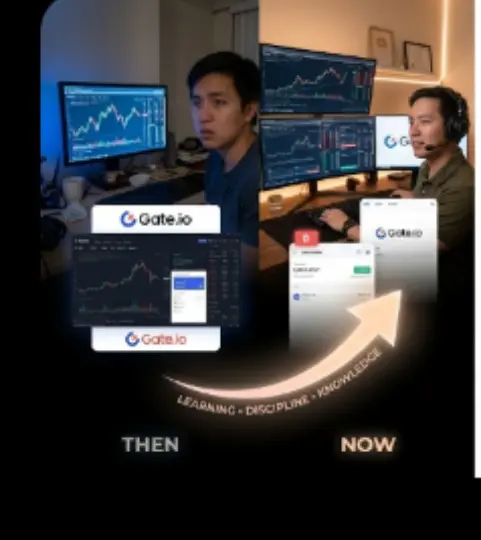

Thời gian trôi qua nhanh, hãy tham gia nhanh để tối đa hóa quyền phân bổ của bạn

🔹 33.900 cổ phiếu $SPCX đang chờ đặt mua, giá đặt mua là $590

🔹 Càng đặt mua sớm, quyền phân bổ càng cao

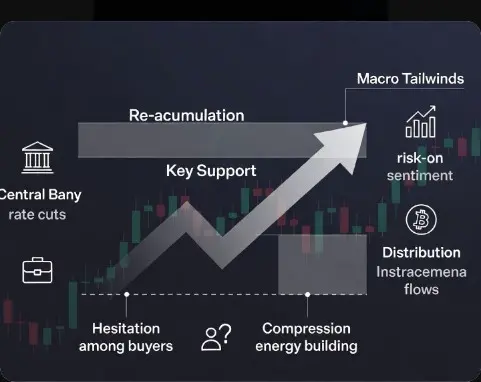

🎁 Người dùng mới tham gia đặt mua vào Quỹ Tiền Tệ, tối đa hưởng lợi nhuận hàng năm lên đến 200%

🎁 Người dùng VIP 5+ và đại lý siêu cấp đang nhận thêm phần thưởng phân phát liên tục, tham gia ngay: https://www.gate.com/ipos/2