ヴィタリック・ブテリンの詳細な見解:AIは完全な自律性を目指すのではなく、人間の能力を高めることに注力すべき

画像提供:https://x.com/VitalikButerin

最新の見解の背景

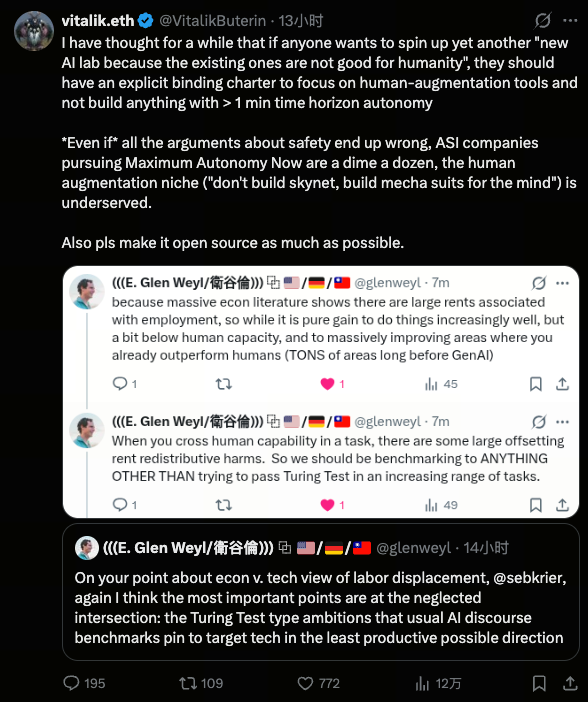

Ethereum共同創設者Vitalik Buterinは、AIの未来は完全自律型の超知能(ASI)システムの追求ではなく、人間の能力強化に重点を置くべきだと主張しています。SNSやパブリックコメントを通じて、AIラボは明確な憲章を定め、人間と機械の協働や拡張ツール開発を優先すべきだと強調しています。さらに、1分以上自律運用できるシステムの開発は避けるべきだと推奨しています。

この見解は、AIの安全性や自律性リスク、規制枠組みを巡る世界的な議論が激化する中で示されています。汎用AI(AGI)や超知能AI(ASI)が世間の議論の中心となり、AIが人間の意思決定を置き換えたり、制御を超えたりする可能性が、テクノロジー業界や社会全体で重要なテーマとなっています。

Vitalikの主張の核心

Vitalikの主張は以下の2点に集約されます:

- AIは人間の能力拡張に注力すべきであり、これは社会にとって真に有益だが、十分に発展していない分野である。

- 長時間自律的に意思決定するシステムの開発は避けるべきであり、自律運用を1分以内に制限することで、人間がAIの行動範囲を常に制御できるようにすべきだと提案しています。

多くのASI企業が高い自律性を追求する一方、人間の推論支援や生産性向上、社会進歩を促すAIツールはまだ少ないと指摘しています。技術研究や社会的関心を、人間の認知や能力強化分野にシフトすべきだと提唱しています。

AI自律性と人間拡張

完全自律型AIは、即時の人間制御を離れて独立して意思決定や行動を実行するシステムを指します。こうしたシステムは高度な複雑性と可能性を持ちますが、倫理・安全・制御喪失のリスクも伴います。

一方、人間拡張型AIは、人間の思考・意思決定・身体的作業を支援することに焦点を当てています。例えば、情報処理の高度化、創造的作業の支援、複雑なシステム解析の最適化などです。これらのツールは明確な利用範囲があり、人間の入力や監督に依存し、人間と機械の協働が現実の業務に統合されています。

人間と機械の協働の将来価値

Vitalikの見解はAI自律性を全面否定するものではなく、AIの価値の境界を再定義するものです。AIは人間の意思決定を置き換えるのではなく、能力を強化することで最大の社会的利益をもたらし、効率性・安全性・倫理基準を向上させると強調しています。

今後数十年、人間とAIの協働は生産性変革の基盤となり、社会の安定と技術倫理のバランス確保に重要な役割を果たす可能性があります。このモデルでは、AIは拡張ツールとして位置づけられ、人間の監督を逸脱した意思決定を防ぎます。

技術と倫理のバランスに関する課題

AI開発の方向性を考える際、倫理基準と技術的制約はどちらも重要です。AIシステムが複雑なタスクに十分対応できるようにしつつ、悪用・乱用・制御喪失を防ぐ強力な「制約」を導入することが不可欠です。これには、アルゴリズムの透明性、オープンソース文化の促進、社会的監督の仕組みの確立が含まれます。

Vitalikは、開発プロセスやアルゴリズムの論理を透明化するため、オープンソースAIプロジェクトの推進を提唱しています。このアプローチにより、多様な開発者や監督機関が協働し、閉鎖的開発による独占リスクやセキュリティ懸念を軽減し、技術の健全な進化を促進します。

業界発展への示唆

Vitalikの洞察はAI業界に次のような指針を示します:

- 極端な自律性の追求だけでなく、人間拡張ツールの開発に投資する企業を増やす。

- AIが効率性を高めながら、安全かつ制御可能であり続けるよう、倫理的ガイドラインの確立を重視する。

- AI技術の透明性を高め、社会的監督と広範な参加を促進するため、オープンソース文化を推進する。

このアプローチは、AI安全性の第一人者らの見解とも一致しており、自律性の過度な追求は不確実性やリスクを増加させる一方、支援型AIは人間の制御と意思決定への関与を強化すると警告しています。

結論と今後の展望

Vitalik ButerinによるAIへの考察は、技術的評価を超え、AIの社会的影響や人類の未来への深い懸念を示しています。技術進化とAI能力の拡大が進む中、人間中心を維持し、テクノロジーが人類に奉仕することを確実にする課題は、グローバルな技術コミュニティと社会が協力して取り組むべきものです。

今後、AI開発は人間と知能システムの共進化により一層焦点が当てられると予測されます。この流れは、テクノロジー、教育、ガバナンス、経済構造の変革を牽引する重要な原動力となるでしょう。

関連記事

Forkast (CGX): ゲームやインターネット文化向けに構築された予測市場プラットフォーム

Piコインを売却する方法:初心者向けガイド

Radiant Multi-Signature Attackを使用したBybitハックの分析を例に

$MAD: MemesAfterDark – The Ultimate Degen Token

Piノード:誰もが参加できるブロックチェーンノード