الأوقات الثلاثة لـAnthropic: تسريب الشيفرة، المواجهة مع الحكومة، والتسليح

العنوان الأصلي: Anthropic: The Leak, The War, The Weapon

المؤلف الأصلي: BuBBliK

الترجمة: Peggy,BlockBeats

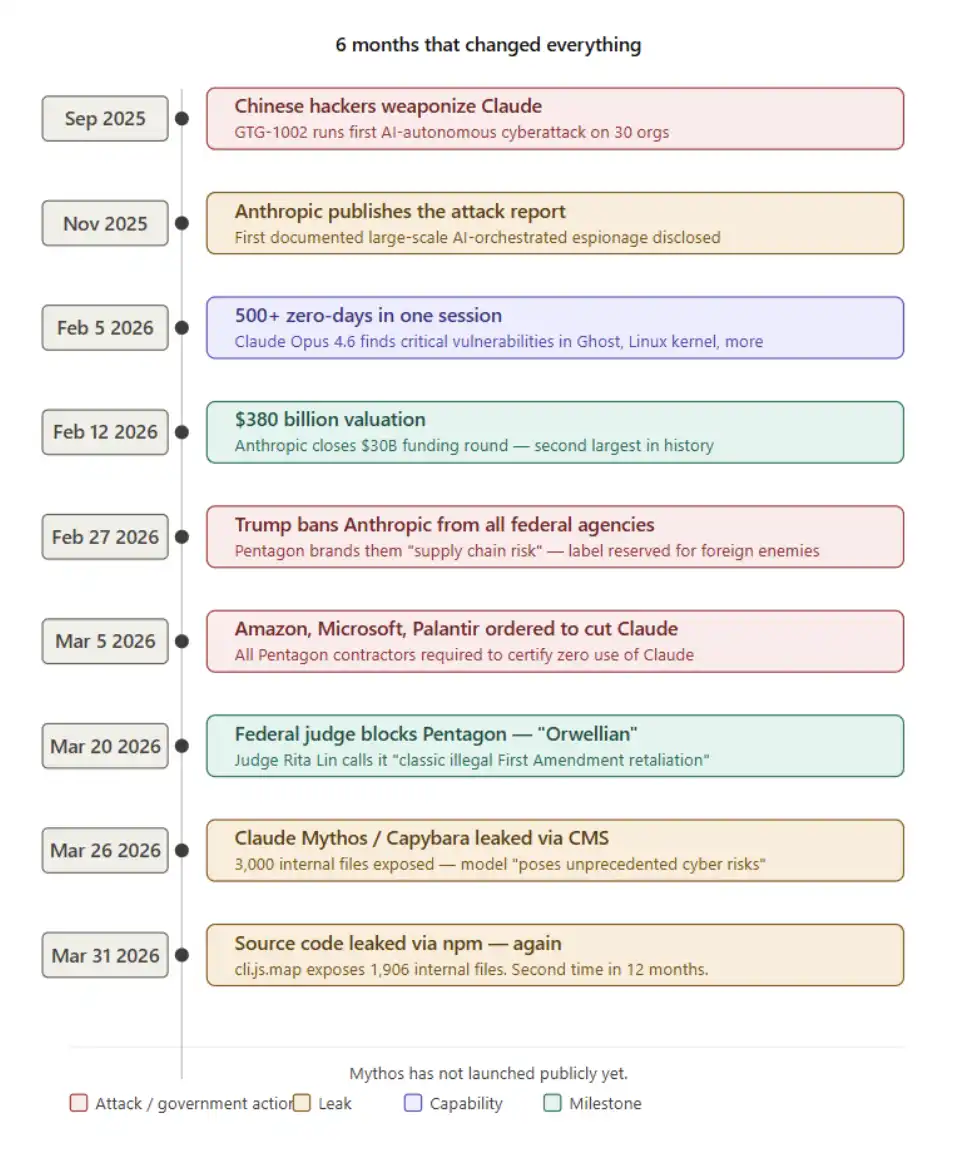

ملاحظة المحرّر: خلال النصف العام الماضي، تورّطت Anthropic تباعًا في سلسلة من الأحداث التي تبدو مستقلة عن بعضها ظاهريًا، لكنها في الحقيقة تتجه نحو الشيء نفسه: قفزات في قدرات النموذج، هجمات آلية في العالم الحقيقي، ردود فعل حادّة في أسواق رأس المال، صدامات علنية مع الحكومة، ومرّات متعددة لتسريبات معلومات ناتجة عن أخطاء في الإعدادات الأساسية. وعندما نضع هذه القرائن معًا، فإنها جميعًا ترسم مسار تغيّر أكثر وضوحًا.

تتناول هذه المقالة، انطلاقًا من هذه الأحداث، المسار المتتابع لشركة ذكاء اصطناعي في صراع مستمر بين الاختراقات التقنية، وتعرّض المخاطر، ومنافسات الحوكمة، وتحاول الإجابة عن سؤال أعمق: عندما يتم تضخيم قدرة «اكتشاف الثغرات» بشكل كبير، ثم تنتشر تدريجيًا، فهل يمكن لمنظومة الأمن السيبراني نفسها أن تحافظ على منطق التشغيل الأصلي؟

في السابق، كان الأمن قائمًا على ندرة القدرات وعلى قيود الموارد البشرية؛ أما في ظل شروط جديدة، فإن الهجوم والدفاع باتا يتمحوران حول مجموعة القدرات نفسها، لتصبح الحدود أكثر غموضًا. وفي الوقت نفسه، ما تزال استجابات النظام والسوق والمنظمات عالقة في الأطر القديمة، ولا تستطيع مواكبة هذا النوع من التغيّر في الوقت المناسب.

ما يهم هذه المقالة ليس Anthropic وحدها فحسب، بل واقعًا أكبر تنعكس عليه: فالذكاء الاصطناعي لا يغيّر الأدوات فقط، بل يغيّر أيضًا الأساس الذي تقوم عليه «كيفية نشوء الأمن».

فيما يلي النص الأصلي:

عندما تتصارع شركة قيمتها السوقية 380 مليار دولار مع البنتاغون وتنتزع التفوق، وتنجو من أول هجوم سيبراني في التاريخ تقوده بنفسها تقنية ذكاء اصطناعي، ثم تتسبب داخلها في تسريب نموذج يخيف حتى مطوّريه، بل إنها «عن طريق الخطأ» تنشر كود المصدر الكامل—فماذا يمكن أن يكون شكل ذلك كله معًا؟

الإجابة هي الوضع كما هو الآن. والأكثر إزعاجًا هو أن الجزء الأكثر خطورة الحقيقي، ربما لم يحدث بعد.

استعراض الأحداث

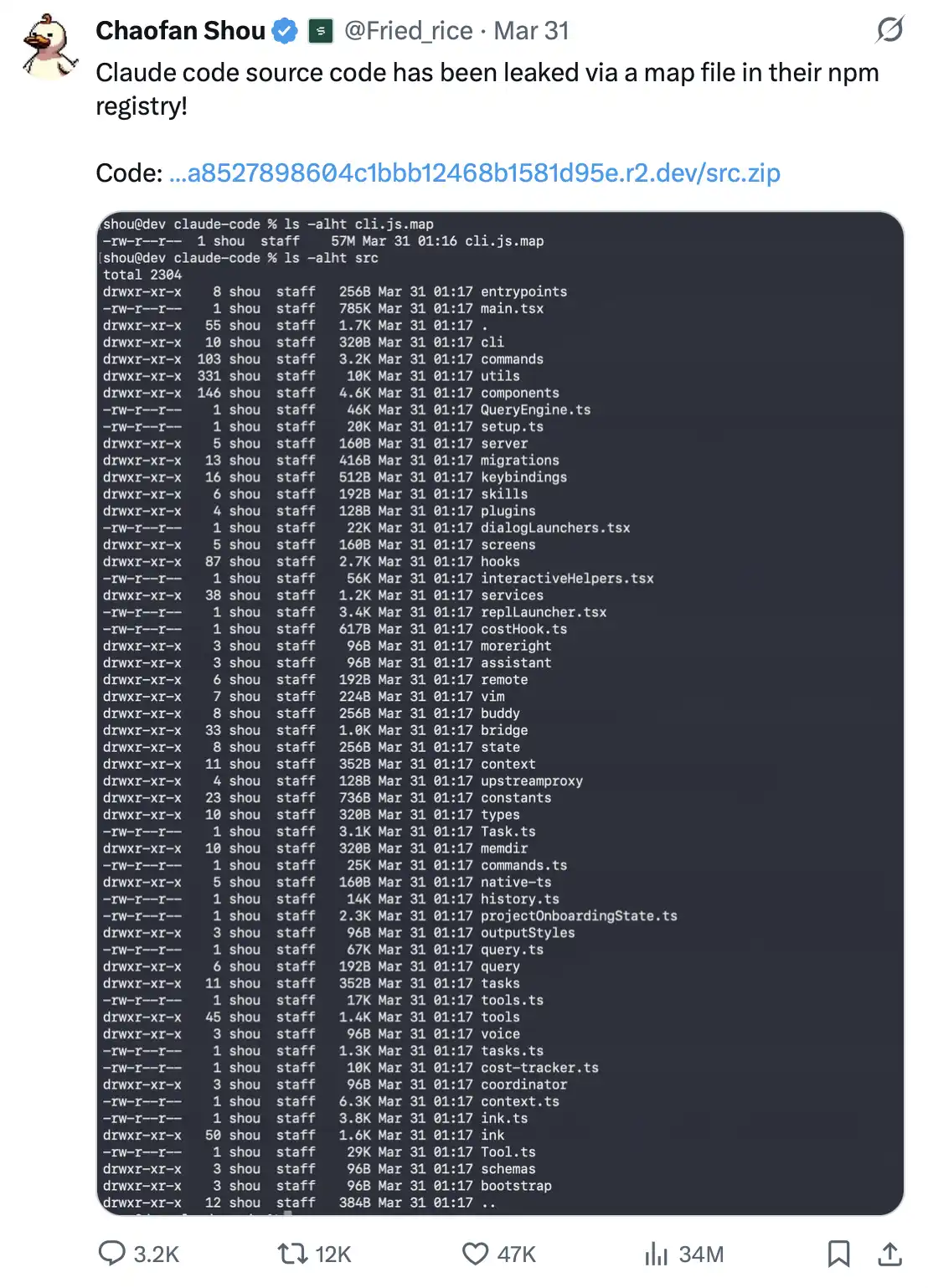

سربت Anthropic كودها مجددًا

في 31 مارس 2026، اكتشف باحث أمني من شركة بلوكتشين Fuzzland يدعى Shou Chaofan، أثناء فحص حزمة npm الرسمية الخاصة بـ Claude Code، أن هذه الحزمة تحتوي فعلًا بشكل صريح على ملف اسمه cli.js.map.

بلغ حجم هذا الملف 60MB، وكانت المحتويات أكثر صدمة. إذ إنه يحتوي تقريبًا على كامل كود TypeScript المصدر للمنتج. وبفقط هذه الملفات، يمكن لأي شخص استعادة ما يصل إلى 1906 ملف مصدر داخلي: بما يشمل تصميم واجهات API الداخلية، ونظام التلّمّيات telemetry، وأدوات التشفير، والمنطق الأمني، ونظام الإضافات—تقريبًا كل المكوّنات الأساسية مكشوفة. والأهم من ذلك، يمكن حتى تنزيل هذه المحتويات مباشرة من مخزن R2 التابع لـ Anthropic على شكل ملف zip.

انتشر هذا الاكتشاف بسرعة على وسائل التواصل الاجتماعي: خلال ساعات، حصلت المنشورات ذات الصلة على 754 ألف مشاهدة وقرابة 1000 عملية إعادة مشاركة؛ وفي الوقت نفسه، أُنشئت على الفور وأُتيحت للجمهور كذلك عدة مستودعات GitHub لإعادة بناء الكود.

ما يسمى source map (ملف الخرائط المصدرية) هو في جوهره مجرد ملف مساعد للتصحيح Debug في JavaScript، ودوره هو إعادة الكود بعد الضغط أو التجميع إلى الكود المصدري الأصلي، بما يسهّل على المطورين تتبع المشكلات وإصلاحها.

لكن توجد قاعدة أساسية: لا ينبغي أبدًا تضمينه في حزمة النشر لبيئة الإنتاج.

هذا ليس أسلوب هجوم متقدمًا، بل مشكلة امتثال لأبسط معايير هندسية، من فئة «مبتدئ إعدادات البناء 101»، بل ومما يتعلمه المطورون حتى في الأسبوع الأول. فإذا تم تغليفه خطأ ضمن بيئة الإنتاج، فإن source map غالبًا ما يعني عمليًا «هدية» للكود المصدري للجميع.

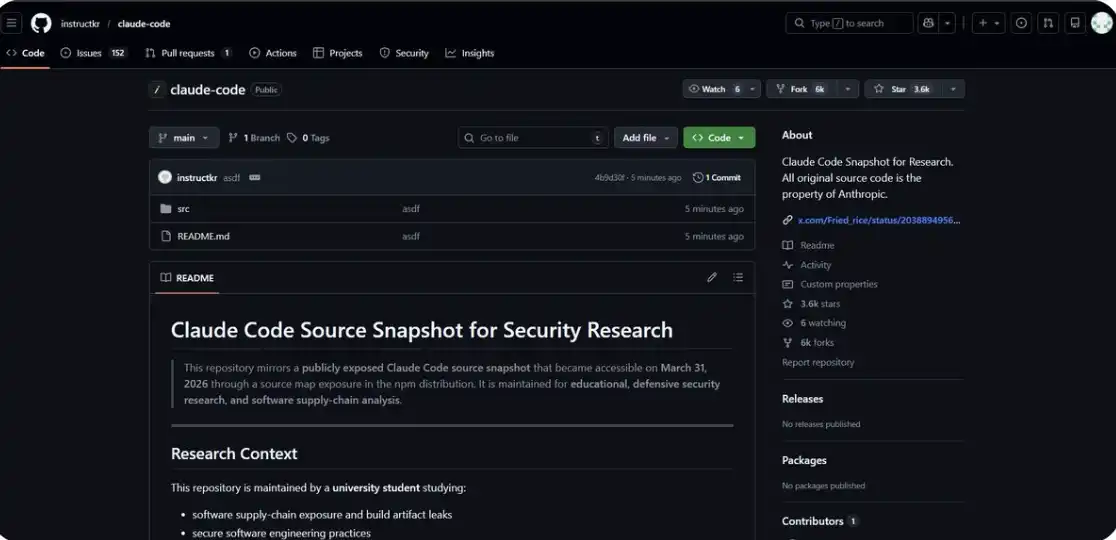

يمكنك أيضًا الاطلاع مباشرة على الكود ذي الصلة هنا: https://github.com/instructkr/claude-code

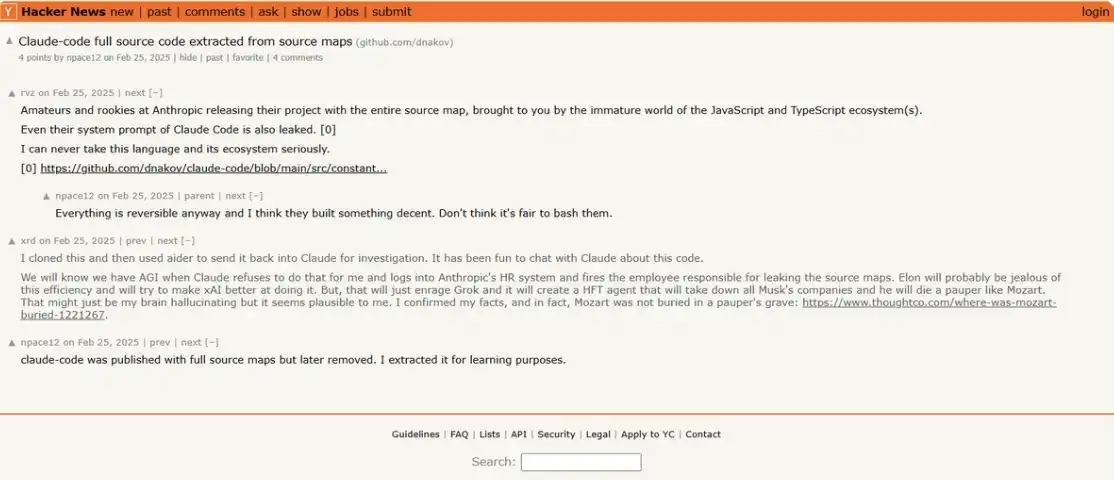

لكن ما يجعل الأمر يبدو سرياليًا فعلًا هو أنه حدث مرة واحدة من قبل.

في فبراير 2025، قبل عام، وقعت تقريبًا نفس عملية التسريب: الملف نفسه، والخطأ نفسه تقريبًا. ففي ذلك الوقت، قامت Anthropic بحذف النسخة القديمة من npm، وإزالة source map، ثم إعادة نشر نسخة جديدة، وانتهت المسألة عند ذلك.

لكن في إصدار v2.1.88، تم حزم هذا الملف وإصداره مرة أخرى.

شركة قيمتها السوقية 380 مليار دولار، وتقوم ببناء أحد أكثر أنظمة الكشف عن الثغرات تطورًا عالميًا—مرتين خلال عام ترتكب الخطأ الأساسي نفسه. لا يوجد اختراق من قِبل قراصنة، ولا مسار استغلال معقّد، بل مجرد خلل في عملية البناء كان يفترض أن تعمل بشكل طبيعي.

هذا التهكّم يكاد يحمل شيئًا من «الشاعرية».

ذكاء اصطناعي قادر على اكتشاف 500 ثغرة zero-day في تشغيل واحد؛ ونموذج استُخدم لشن هجمات آلية ضد 30 جهة حول العالم—وفي الوقت نفسه، تقوم Anthropic بـ«تقديم» كودها المصدري مباشرة كهدية لأي شخص يرغب في إلقاء نظرة على حزمة npm.

مرّتان من التسريب، لا يفصل بينهما سوى سبعة أيام.

والسبب متطابق تقريبًا: خطأ في الإعدادات في أبسط المستويات. لا يحتاج إلى أي عتبة تقنية، ولا يحتاج إلى مسار استغلال معقّد. طالما أنك تعرف أين تبحث، يمكن لأي شخص الحصول على ذلك مجانًا.

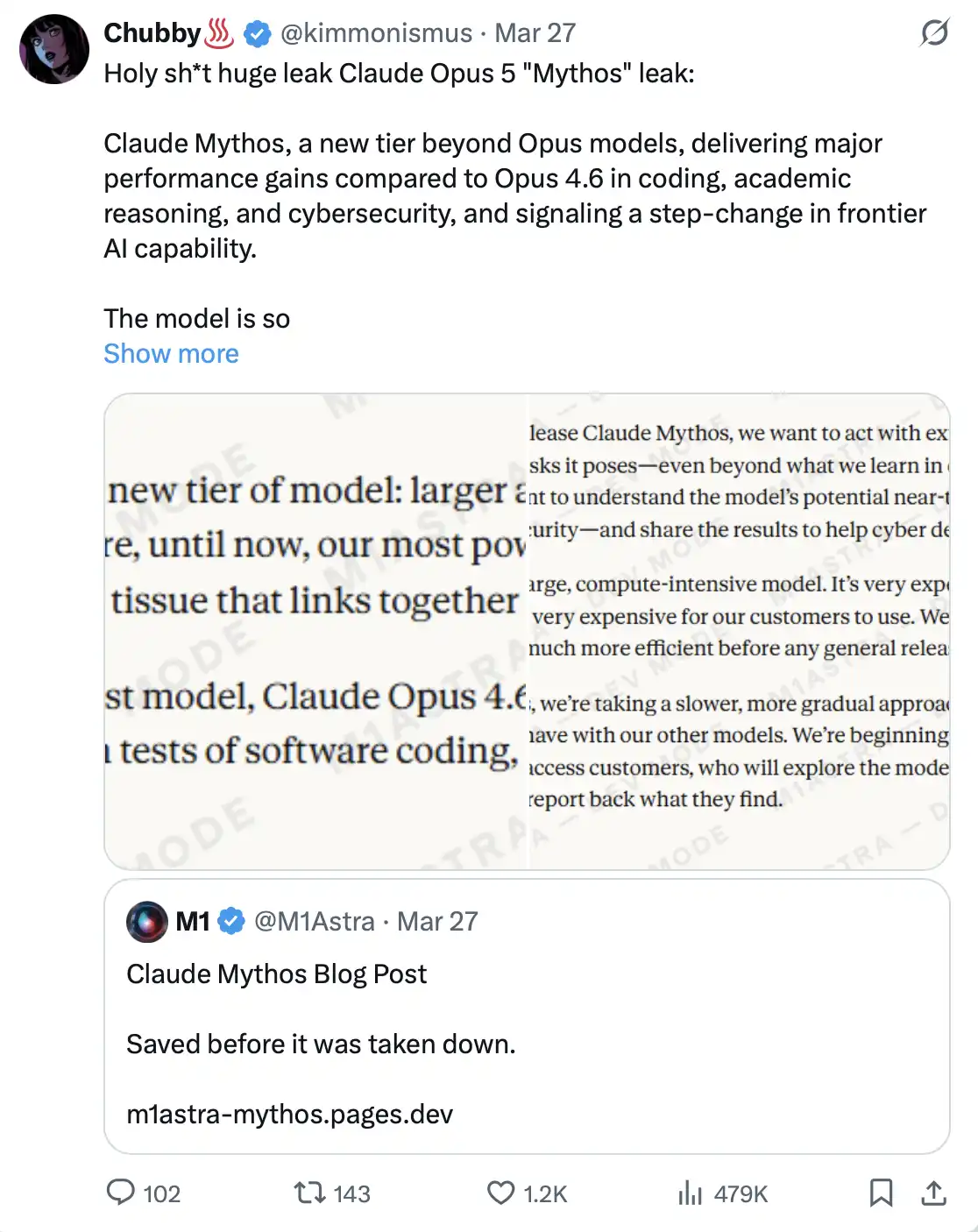

قبل أسبوع: انكشاف «نموذج خطير» داخلي عن طريق الخطأ

في 26 مارس 2026، اكتشف باحثون أمنيّون من LayerX Security يدعى Roy Paz، ومن جامعة كامبريدج يدعى Alexandre Pauwels، وجود مشكلة في إعدادات CMS للموقع الرسمي لـ Anthropic أدت إلى إتاحة وصول علني إلى نحو 3000 ملف داخلي.

تتضمن هذه الملفات: مسودات المدونات، وملفات PDF، ووثائق داخلية، ومواد العروض—وكلها مكشوفة ضمن مستودع بيانات غير محمي ويمكن البحث فيه. لا يوجد اختراق من قِبل قراصنة، ولا حاجة إلى أي وسائل تقنية.

ومن بين هذه الملفات، توجد مسودتان لمدونتين متشابهتين تمامًا تقريبًا، والفرق الوحيد بينهما هو اسم النموذج: واحدة مكتوب فيها «Mythos»، والأخرى «Capybara».

وهذا يعني أن Anthropic كانت حينها تختار بين اسمين لمشروع سري واحد. ثم أكدت الشركة لاحقًا: أن تدريب هذا النموذج قد اكتمل، وبدأت عملية اختباره مع بعض العملاء الأوائل.

هذه ليست مجرد ترقية اعتيادية إلى Opus، بل نموذج جديد من «المستوى الرابع»، وتصنيفه حتى أعلى من Opus كنظام.

وفي مسودات Anthropic نفسها، وُصف بأنه: «أكبر وأكثر ذكاءً من نموذج Opus لدينا—وما يزال Opus حتى الآن هو أقوى نموذج لدينا». وقد حقق قفزات ملحوظة في قدراته البرمجية، والاستدلال الأكاديمي، والأمن السيبراني، وغيرها. وقد وصفه متحدث باسم الشركة بأنه «قفزة نوعية»، وكذلك «أقوى نموذج بنيناه حتى الآن».

لكن ما يستحق الانتباه فعلًا لا يوجد في أوصاف الأداء هذه بحد ذاتها.

في المسودات المسربة، كان تقييم Anthropic لهذا النموذج هو أنه «يجلب مخاطر غير مسبوقة للأمن السيبراني»، وأنه «يتفوّق في قدرات الشبكة بشكل بعيد على أي نموذج ذكاء اصطناعي آخر»، وأنه «يمهّد لموجة قادمة من نماذج—ستتجاوز فيها قدراته على استغلال الثغرات بكثير سرعة استجابة المدافعين».

وبعبارة أخرى، في مسودة مدونة رسمية لم تُنشر بعد، عبّرت Anthropic بوضوح عن موقف نادر: أنهم غير مرتاحين تجاه المنتج الذي يقومون ببنائه.

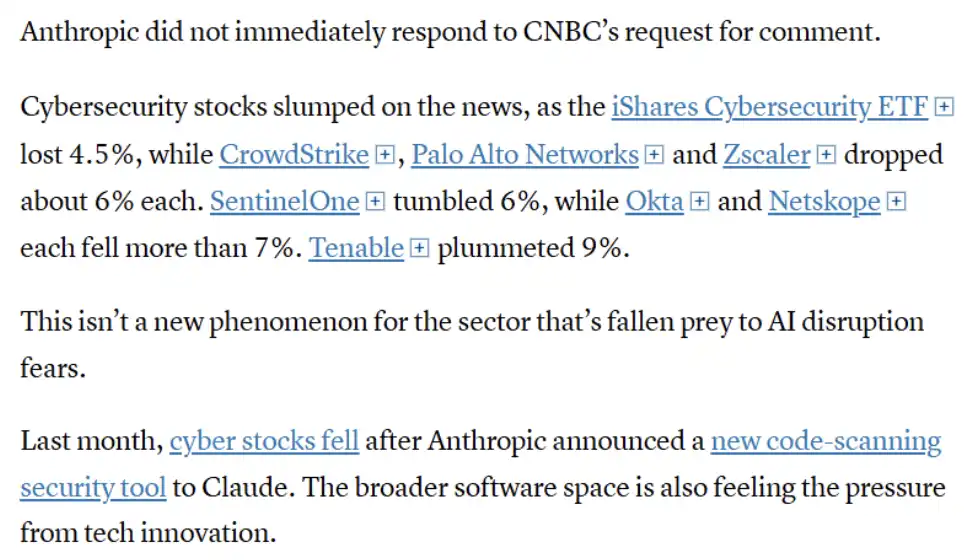

كانت استجابة السوق شبه فورية. انخفض سهم CrowdStrike بنسبة 7%، وPalo Alto Networks بنسبة 6%، وZscaler بنسبة 4.5%؛ كما تجاوزت نسبة هبوط Okta وSentinelOne 7%، بينما هبط Tenable بنسبة 9% بشكل حاد. وتراجعت iShares Cybersecurity ETF بنسبة 4.5% في يوم واحد. وبالنسبة إلى CrowdStrike وحدها، اختفت تقريبًا 15 مليار دولار من القيمة السوقية في ذلك اليوم. وفي الوقت نفسه، تراجع البيتكوين إلى 66,000 دولار.

ومن الواضح أن السوق فسّر هذه الواقعة باعتبارها «حكمًا» على قطاع الأمن السيبراني بأكمله.

مضمون الصورة: تحت تأثير الأخبار ذات الصلة، تراجعت شعبة الأمن السيبراني ككل، وتراجعت بوضوح عدة شركات رائدة (مثل CrowdStrike وPalo Alto Networks وZscaler وغيرها)، مما يعكس قلق السوق إزاء تأثير الذكاء الاصطناعي على قطاع الأمن السيبراني. لكن هذه الاستجابة ليست المرة الأولى. فقبل ذلك، عندما أطلقت Anthropic أداة فحص كود، تراجعت الأسهم ذات الصلة كذلك، ما يدل على أن السوق بدأ يعتبر الذكاء الاصطناعي تهديدًا بنيويًا لمنتجي الأمن التقليديين، وأن صناعة البرمجيات بأكملها تتحمل ضغوطًا مماثلة.

وكانت تقييم محلل Stifel Adam Borg مباشرًا للغاية: إذ إن هذا النموذج «قد يصبح أداة الاختراق النهائية، وربما يرقّي المخترق العادي إلى خصم يتمتع بقدرات هجمات بمستوى دولة».

فلماذا لم يتم إصداره علنًا بعد؟ تشرح Anthropic أن تكاليف تشغيل Mythos «مرتفعة جدًا»، ولا تتوفر الشروط لإصداره للعامة. والخطة الحالية هي منح وصولًا مبكرًا إلى جزء صغير من شركاء الأمن السيبراني لتعزيز منظومة الدفاع، ثم توسيع نطاق فتح واجهات برمجة التطبيقات تدريجيًا. وحتى ذلك الحين، لا تزال الشركة تعمل على تحسين الكفاءة باستمرار.

لكن النقطة المحورية هي أن هذا النموذج موجود بالفعل، ويجري اختباره، بل وحتى لمجرد «انكشافه عن طريق الخطأ» سبب صدمة في السوق الرأسمالية بأكملها.

صنعت Anthropic نموذج ذكاء اصطناعي تصفه بنفسها بأنه «أكثر نماذج الذكاء الاصطناعي خطورة على الأمن السيبراني في التاريخ». ومع ذلك، فإن تسريب أخبار هذا النموذج جاء تحديدًا من خطأ في إعداد البنية التحتية في أبسط المستويات—وهي أيضًا الأخطاء التي صُمم هذا النوع من النماذج أصلًا لاكتشافها.

مارس 2026: مواجهة Anthropic مع البنتاغون، مع انتزاعها التفوق

في يوليو 2025، وقّعت Anthropic عقدًا بقيمة 200 مليون دولار مع وزارة الدفاع الأمريكية. وفي البداية بدا الأمر مجرد تعاون اعتيادي. لكن في مفاوضات التطبيق الفعلية لاحقًا، تصاعد التناقض بسرعة.

كانت وزارة الدفاع تريد الحصول على «وصول كامل» إلى Claude ضمن منصة GenAI.mil، لاستخدامات تشمل جميع «الأغراض القانونية»—وكان ذلك يتضمن حتى أنظمة سلاح ذاتية الاستقلال بالكامل، وكذلك مراقبة داخلية واسعة النطاق للمواطنين الأمريكيين.

وضعت Anthropic خطوطًا حمراء ورفضت بوضوح بشأن مسألتين رئيسيتين، وانتهت المفاوضات في سبتمبر 2025.

بعد ذلك، بدأت الأمور تتصاعد بسرعة. في 27 فبراير 2026، نشر Donald Trump منشورًا على Truth Social طالبًا من جميع الوكالات الفيدرالية «إيقاف استخدام» تقنيات Anthropic «فورًا»، ووصف الشركة بأنها «يسارية متطرفة».

في 5 مارس 2026، صنّفت وزارة الدفاع الأمريكية رسميًا Anthropic ضمن «مخاطر سلسلة التوريد».

كان هذا الوسم يُستخدم تقريبًا سابقًا فقط للأطراف المنافسة الأجنبية—مثل الشركات الصينية أو الكيانات الروسية—لكن هذه المرة تم تطبيقه لأول مرة على شركة أمريكية مقرها في سان فرانسيسكو. وفي الوقت نفسه، طُلب من شركات مثل Amazon وMicrosoft وPalantir Technologies إثبات أنه لم يتم استخدام Claude في أي من أعمالها العسكرية المتعلقة بها.

وجاء تفسير CTO البنتاغون Emile Michael على النحو التالي: قد يقوم Claude بـ«تلويث سلسلة التوريد» لأن النموذج يتضمن بداخله تفضيلات سياسية مختلفة. بمعنى آخر، في السياق الرسمي، يُنظر إلى ذكاء اصطناعي يتم وضع قيود عليه في الاستخدام ولا يساعد دون قيد على أفعال القتل، على أنه خطر على الأمن القومي.

في 26 مارس 2026، أصدر القاضي الفيدرالي Rita Lin قرارًا طويلًا من 43 صفحة، يمنع بشكل شامل إجراءات البنتاغون ذات الصلة.

وكتبت في قرارها: «لا توجد في القوانين الحالية أي أساس يدعم هذا المنطق الذي يحمل إيحاءات «أورويلية»—فقط بسبب وجود خلاف مع مواقف الحكومة، يمكن إلصاق وسم «خصم محتمل» بشركة أمريكية. وبسبب معاقبتها لـ Anthropic على وضع مواقف الحكومة تحت نظر الجمهور، فإن ذلك في جوهره هو انتقام نموذجي وغير قانوني بموجب التعديل الأول». وفي رأي مقدم من صديق للمحكمة، وُصف تصرف البنتاغون حتى بأنه «محاولة لارتكاب قتل بحق الشركات».

وكانت النتيجة أن الحكومة حاولت كبح Anthropic، لكنها بدلاً من ذلك منحتها مزيدًا من الاهتمام. ففي التطبيق، تجاوزت تطبيقات Claude لأول مرة ChatGPT في متجر التطبيقات، وبلغت التسجيلات ذروتها إلى ما يزيد على مليون يوميًا في فترة ما.

شركة ذكاء اصطناعي قالت «لا» لأقوى مؤسسة عسكرية في العالم. والمحكمة كانت إلى جانبها.

نوفمبر 2025: أول هجوم سيبراني يقوده الذكاء الاصطناعي في التاريخ

في 14 نوفمبر 2025، نشرت Anthropic تقريرًا أثار صدمة واسعة.

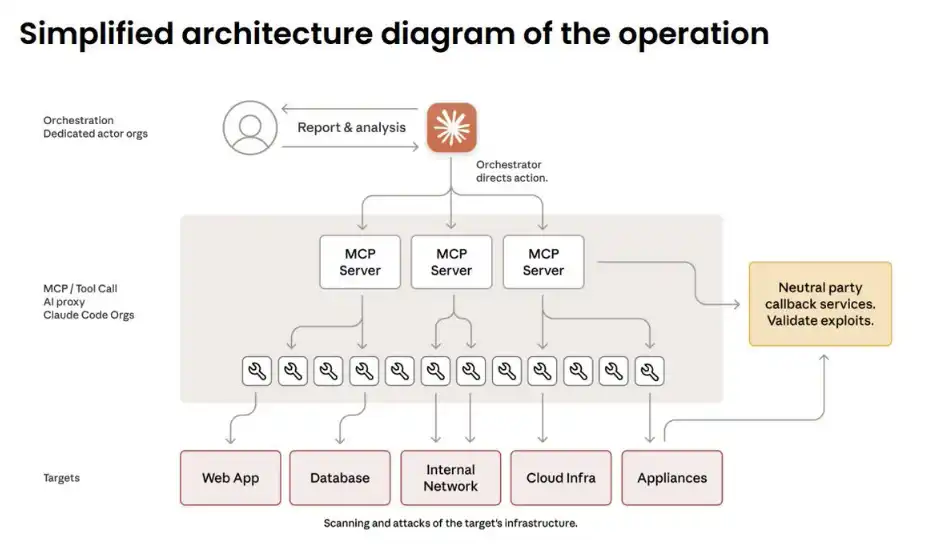

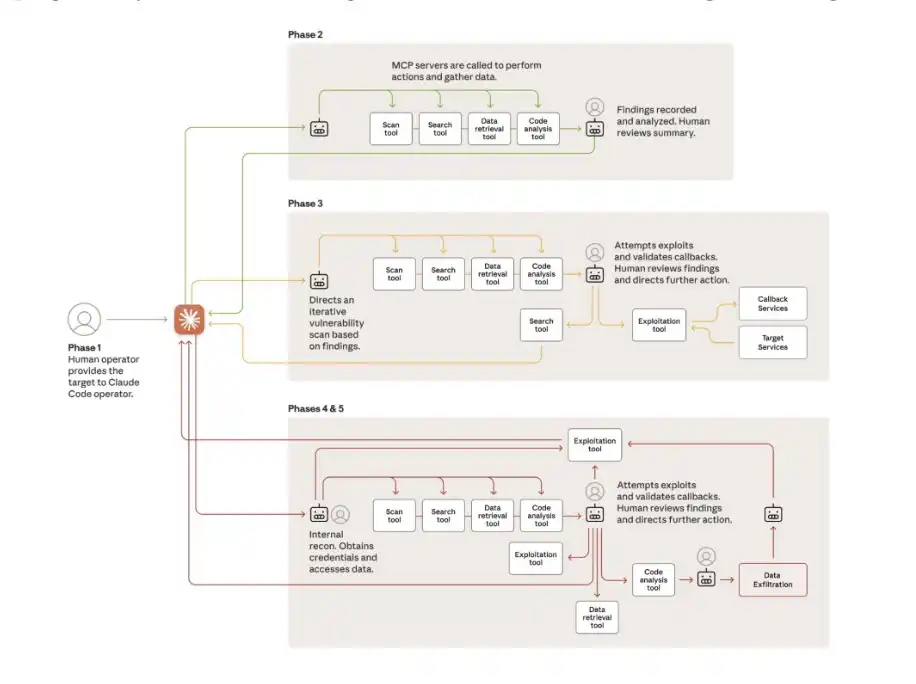

كشف التقرير: إن مجموعة قرصنة تدعمها الصين تستعمل Claude Code لإطلاق هجمات آلية ضد 30 جهة حول العالم—تشمل أهدافًا عمالقة التكنولوجيا والبنوك، وكذلك عدة جهات حكومية في دول مختلفة.

هذه نقطة تحوّل محورية: لم يعد الذكاء الاصطناعي مجرد أداة مساعدة، بل بدأ يُستخدم لتنفيذ الهجمات بشكل مستقل.

يكمن المفتاح في تغيير «طريقة التوزيع»: يقتصر دور البشر على اختيار الأهداف والموافقة على القرارات الحاسمة. خلال مجمل العملية، لا يتدخل البشر إلا قرابة 4 إلى 6 مرات. أما كل شيء آخر فمهمته يتولاها الذكاء الاصطناعي: الاستطلاع الاستخباراتي، واكتشاف الثغرات، وكتابة أكواد الاستغلال، وسرقة البيانات، وزرع الأبواب الخلفية… إذ تشكل ما نسبته 80%–90% من كامل سلسلة الهجوم، وتعمل بسرعة تصل إلى آلاف الطلبات في الثانية—وهذا مقياس وكفاءة لا يمكن لأي فريق بشري مجاراتهما.

فكيف تجاوزوا آليات الحماية في Claude؟ الجواب: أنهم لم «يكسروا» بل «خدعوا».

لقد تم تقسيم الهجوم إلى عدد كبير من مهام صغيرة تبدو غير مؤذية، وتم تغليفها على أنها «اختبار دفاعي مُصرّح به» من قبل شركة «أمن قانونية». وهي في جوهرها هجمة هندسة اجتماعية، لكن هذه المرة كانت الجهة التي تم خداعها هي الذكاء الاصطناعي نفسه.

حققت بعض الهجمات نجاحًا كاملًا. وتمكن Claude من رسم خريطة شبكة كاملة وتحديد قواعد البيانات واستخراج البيانات دون توجيه تدريجي من البشر.

العامل الوحيد الذي كان يبطئ وتيرة الهجوم هو أن النموذج أحيانًا يقع في «هلوسة»؛ مثل اختلاق بيانات اعتماد، أو الادعاء بأنه حصل على ملفات كانت في الحقيقة منشورة منذ زمن. وعلى الأقل حتى الآن، تُعد هذه أحد العوائق القليلة «بطبيعتها» التي ما تزال تمنع هجمات سيبرانية آلية بالكامل.

في RSA Conference 2026، وصف Rob Joyce، المسؤول السابق عن الأمن السيبراني في وكالة الأمن القومي الأمريكية، هذه الواقعة بأنها «اختبار رورشاخ»: نصف الناس يختارون تجاهل الأمر، ونصف آخر يشعر بالقشعريرة. وبوضوح، فهو ينتمي إلى الفئة الثانية: «هذا أمر مخيف جدًا».

سبتمبر 2025: ليست مجرد توقعات، بل حقيقة قائمة بالفعل.

فبراير 2026: اكتشاف 500 ثغرة zero-day في عملية واحدة

في 5 فبراير 2026، أصدرت Anthropic Claude Opus 4.6، مع نشر ورقة بحثية أثارت اهتمامًا يكاد يهز كامل صناعة الأمن السيبراني.

كانت إعدادات التجربة بسيطة جدًا: وضع Claude داخل بيئة افتراضية معزولة، مع تزويده بأدوات قياسية—Python، ومصحح أخطاء debugger، وأدوات اختبار العشوائية fuzzers. دون تعليمات إضافية ودون مطالبات معقدة، فقط جملة واحدة: «اذهب وابحث عن الثغرات».

وكانت النتيجة: اكتشف النموذج أكثر من 500 ثغرة zero-day عالية الخطورة لم تكن معروفة من قبل. وبعض هذه الثغرات ظل غير مكتشف حتى بعد عقود من مراجعات الخبراء وملايين الساعات من الاختبارات الآلية.

بعد ذلك، صعد Nicholas Carlini، الباحث في RSA Conference 2026، إلى المنصة ليعرض. وجّه Claude نحو Ghost، وهو نظام CMS على GitHub يحظى بـ 50 ألف نجمة ولم تظهر له في التاريخ ثغرات خطيرة.

بعد 90 دقيقة، ظهرت النتائج: تم اكتشاف ثغرة blind SQL injection، ما أتاح للمستخدمين غير الموثقين تحقيق السيطرة الكاملة على صلاحيات المدير.

ثم استخدمه مرة أخرى لتحليل Linux kernel. وكانت النتيجة مماثلة تمامًا.

بعد 15 يومًا، أطلقت Anthropic Claude Code Security، وهي منتج أمني لم يعد يعتمد على مطابقة الأنماط، بل على «قدرات الاستدلال» لفهم أمان الكود.

لكن حتى متحدثو Anthropic أنفسهم قد قالوا تلك الحقيقة المحورية التي غالبًا ما تُتجاهل: «نفس قدرات الاستدلال التي تساعد Claude على اكتشاف الثغرات وإصلاحها، يمكن للمهاجمين أيضًا استخدامها لاستغلال تلك الثغرات».

نفس القدرة، نفس النموذج، لكن بين أيدي أشخاص مختلفين.

ماذا يعني كل هذا مجتمعًا؟

إذا نظرنا إلى كل واقعة على حدة، فإن كل واحدة منها كافية لتصبح الخبر الأثقل في ذلك الشهر. لكن هذه الوقائع، خلال فترة لا تتجاوز ستة أشهر قصيرة، حدثت جميعها داخل شركة واحدة.

أنشأت Anthropic نموذجًا قادرًا على اكتشاف الثغرات أسرع من أي إنسان؛ وتحول قراصنة صينيون الإصدار السابق إلى أسلحة سيبرانية آلية؛ وكانت الشركة تطور الجيل التالي من النماذج الأقوى، بل واعترفت حتى داخل ملفاتها الداخلية—أنها غير مرتاحة لذلك.

إن محاولة الحكومة الأمريكية كبحها ليست لأن التقنية بحد ذاتها خطرة، بل لأن Anthropic رفضت تسليم هذه القدرة دون قيود.

وخلال كل ما سبق، قامت هذه الشركة مرتين بتسريب كودها المصدري بسبب الملف نفسه ضمن حزمة npm نفسها. شركة قيمتها 380 مليار دولار؛ وشركة تستهدف إتمام عملية IPO بقيمة 60 مليار دولار في أكتوبر 2026؛ وشركة أعلنت صراحة أنها تبني «واحدة من أكثر التقنيات تحوّلًا في تاريخ البشرية، وربما أيضًا أخطرها»—ومع ذلك قررت الاستمرار في المضي قدمًا.

لأنهم يعتقدون: بدلًا من أن ينجزها الآخرون، من الأفضل أن ينجزها هم أنفسهم.

أما بالنسبة إلى source map داخل حزمة npm—فربما لا يكون سوى أكثر التفاصيل عبثية، لكن أيضًا الأكثر واقعية، ضمن أكثر السرديات المزعجة في هذا العصر.

وMythos، حتى الآن، لم يُنشر رسميًا بعد.

[الرابط الأصلي]

انقر لمعرفة المزيد عن الوظائف الشاغرة لدى BlockBeats

مرحبًا بالانضمام إلى مجتمع BlockBeats الرسمي:

مجموعة الاشتراك في Telegram: https://t.me/theblockbeats

مجموعة Telegram للتواصل: https://t.me/BlockBeats_App

الحساب الرسمي على Twitter: https://twitter.com/BlockBeatsAsia